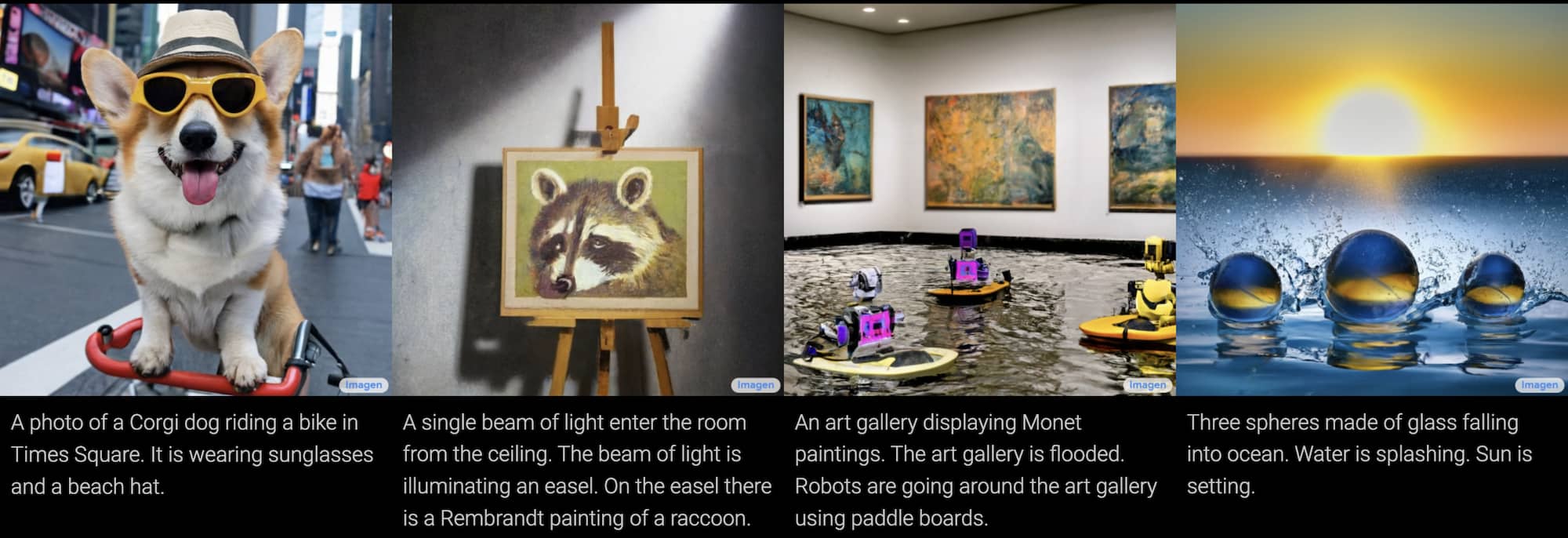

Nas últimas semanas, foi DALL-E 2 Gerador de imagens de IA fazendo ondas no Twitter. Esta noite, o Google publicou sua própria versão chamada “ImagemUm nível profundo de compreensão da linguagem é associado a um “grau sem precedentes de realismo de imagem”. “

para mim A IA do Google lidera Jeff Dean, sistemas de IA como esses “podem desencadear a criatividade combinada de humano/computador” e Imagen “One Direction” [the company is] Perseguição.” O progresso feito pelo Google Research, Brain Team no modelo de publicação de texto para imagem é um nível de realismo. No geral, DALL-E 2 é mais realista com sua saída, mas um olhar mais profundo pode revelar as licenças técnicas oferecidas. (Para mais, certifique-se de Veja este vídeo explicativo.)

O Imagen conta com o poder dos modelos de linguagem de grandes transformadores para entender o texto e depende do poder dos modelos de difusão para gerar imagens de alta resolução. Nossa principal descoberta é que modelos genéricos de linguagem grande (como T5), previamente treinados em um conjunto somente de texto, são surpreendentemente eficazes na codificação de texto para síntese de imagem: aumentar o tamanho do modelo de linguagem no Imagen melhora a precisão da amostra e o texto da imagem alinhamento muito mais do que aumentar o tamanho do modelo de linguagem no Imagen.Formulário de postagem de imagens.

Para demonstrar esse progresso, o Google criou um padrão para avaliar modelos de texto para imagem chamado DrawBench. Os avaliadores humanos preferiram “Imagen a outros modelos em comparações lado a lado, para qualidade da amostra e alinhamento do texto da imagem”. Comparado com VQ-GAN + CLIP, Modelos de Difusão Latente e DALL-E 2.

Enquanto isso, as métricas usadas para demonstrar que o Imagen é melhor em entender as solicitações do usuário incluem relações espaciais, textos longos, palavras raras e prompts difíceis. Outro avanço é a nova e eficiente arquitetura U-Net que “apresenta mais eficiência de computação, maior eficiência de memória e convergência mais rápida”.

O Imagen atinge uma nova pontuação FID de 7,27 no conjunto de dados COCO, sem nenhum treinamento COCO, e os avaliadores humanos descobrem que as amostras do Imagen são iguais aos mesmos dados COCO no alinhamento do texto da imagem.

Na frente de impacto social, o Google decidiu “não lançar um ícone ou demonstração pública” do Imagen neste momento devido a um possível abuso. além de:

O Imagen conta com codecs de texto treinados em dados não saturados de toda a web, herdando assim os preconceitos sociais e as limitações de grandes modelos de linguagem. Como tal, existe o risco de o Imagen criptografar estereótipos e representações maliciosos, o que orienta nossa decisão de não liberar o Imagen para uso público sem outras salvaguardas.

Isso é o que foi dito, há um arquivo Apresentação interativa no sitee as O trabalho de pesquisa está disponível aqui.

Mais sobre a IA do Google:

FTC: Usamos links de afiliados para obter renda. mais.

“Entrepreneur. Professional music nerd. Beer evangelist. Avid tv aficionado. Social mediaholic.”

![Google's Imagen text-to-image generator offers 'unprecedented photorealism' [Gallery]](https://www.bps.pt/wp-content/uploads/2022/05/O-gerador-de-texto-para-imagem-do-Google-Imagen-e.png)